Почти любой проект по разработке искусственного интеллекта для распознавания образов и машинного зрения требует обширной базы данных, в которой содержатся уже распознанные и описанные людьми изображения: на них нейросети обучаются и совершенствуются. Крупнейшая из таких открытых библиотек ImageNet включает более 14 миллионов аннотированных изображений, разделенных по более чем 20 тысячам категорий.

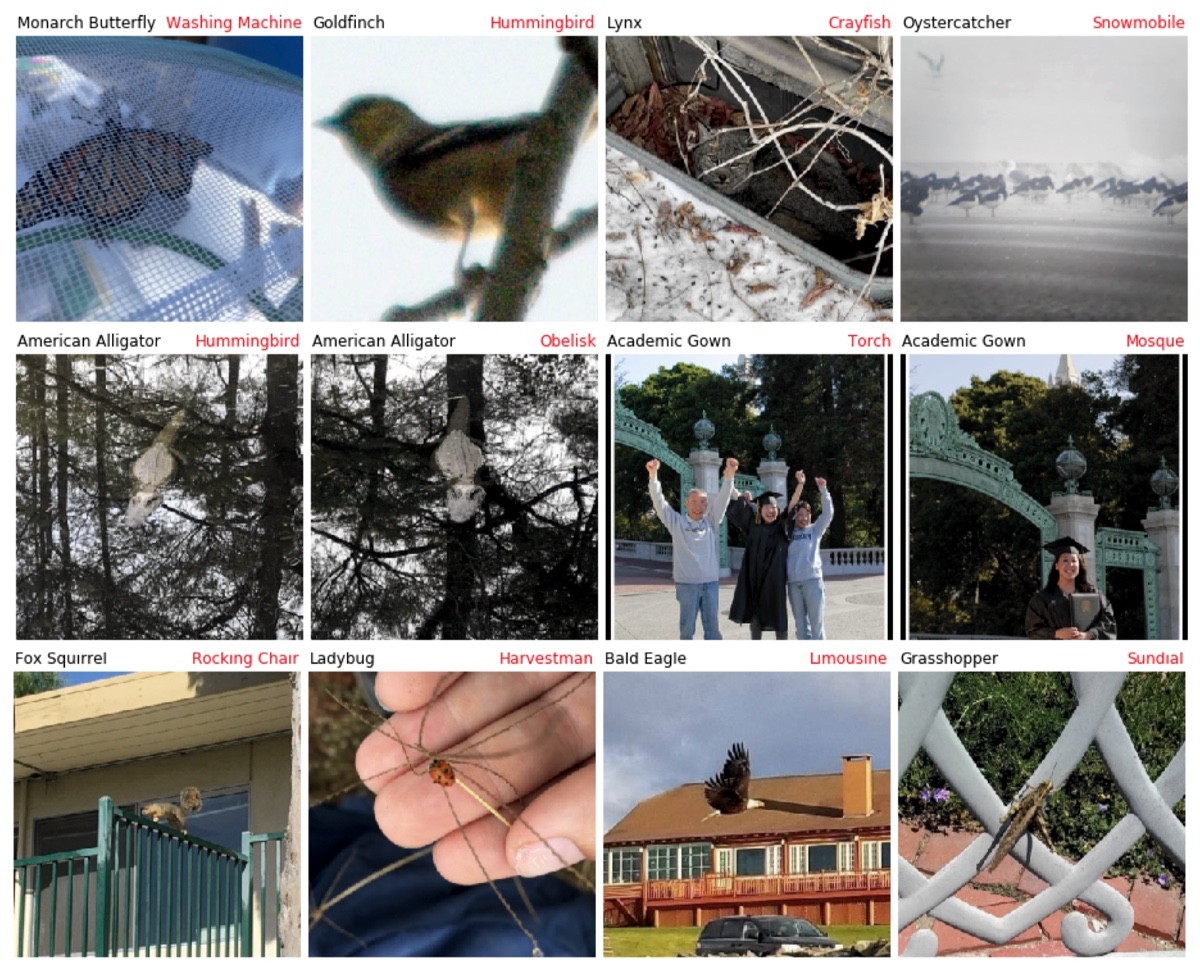

Недавно их список пополнился еще одной — группой ImageNet-A, содержащей фотографии, на которых ошибаются даже самые совершенные алгоритмы ИИ. Новый датасет исследователи из Калифорнийского университета в Беркли представили в статье, опубликованной в онлайн-библиотеке препринтов ArXiv.Org.

По сообщению авторов, набор содержит около 7500 обычных снимков, при распознавании которых нейросети ошибаются в 98 случаях из 100.

Фото: Hendrycks et al

В самом деле, по мере все большего распространения систем машинного зрения все большую опасность приобретают технологии нарушения их работы. Показано, что даже сравнительно небольшой — с точки зрения наших глаз — манипуляцией с картинкой можно сбить с толку даже самый совершенный ИИ, организовав «состязательную атаку» (adversarial attack) на его алгоритмы.

Однако набор ImageNet-A показывает, что подобные изображения могут получаться и без чьего-либо запланированного вмешательства, случайным образом — сами по себе. Следовательно, любое машинное зрение, которому мы собираемся доверить человеческие жизни, должно справляться с появлением таких образов. Именно для этого и появился новый датасет.

По материалам Naked Science

Читайте также:

Искусственный интеллект обыграл 6 профессионалов в покер

Искусственный интеллект решил споры об авторстве хита «Битлз»

Искусственный интеллект может определять внешность по голосу